Nadège Wauquier, professeure documentaliste au lycée Saint Exupéry à Halluin, accompagne ses 23 élèves de Troisième Prépa-métiers au travers d’une séquence pédagogique de deux séances qui visent à développer l’esprit critique des élèves face aux flux d’informations et à les sensibiliser aux enjeux de l’intelligence artificielle dans le traitement de l’information. Cette séance s’inscrit dans le cadre de la 36è Semaine de la Presse et des médias et des TraAM EMI. Cette séance a été adaptée à partir des ressources « comprendre les intentions derrière la diffusion de deepfakes » du dossier pédagogique CLEMI SPME 2025 (p. 27-28).

Cette séance s’inscrit dans les TRAAM EMI en abordant plusieurs axes :

- l’axe 1 sur l’intégrité de l’information en amenant les élèves à distinguer information, mésinformation, désinformation, deepfakes et à se questionner sur : l’IA peut-elle servir l’information ?

- l’axe 2 sur l’évaluation critique des générations et le croisement des sources en invitant les élèves à questionner la fiabilité des sources, à croiser les informations et à identifier les biais ;

- l’axe 4 sur la compréhension technique en interrogeant les intentions des concepteurs d’un narratif produit avec un outil d’IA ;

- l’axe 5 sur la créativité numérique en utilisant des supports vidéos générés par IA.

Contexte :

Le lycée professionnel, comme chaque année, participe à la semaine de la presse en mars 2025. C’est l’occasion de revisiter le paysage informationnel en 2025 sur deux séances dédiées en pédagogie renversée : Où est l’information ? L’IA peut-elle la servir ?

Public : 3 Prépa-métiers

Objectif :

Dans un contexte de production exponentielle et hyper virale de narratifs qui circulent sur le web, sur les réseaux sociaux et sur les médias traditionnels, ces deux séances au 3C animés par la professeure documentaliste dans le cadre du parcours EMI des 3PM ont pour objectifs de :

– Distinguer l’information, de la mésinformation et de la désinformation.

– Distinguer rumeur, opinion et information.

– Questionner les usages de l’IA. Peut-elle servir l’information ? Questionner l’intention dans les usages des nouveaux outils de la 3è révolution digitale ?

Supports à retrouver sur ce padlet.

Compétences :

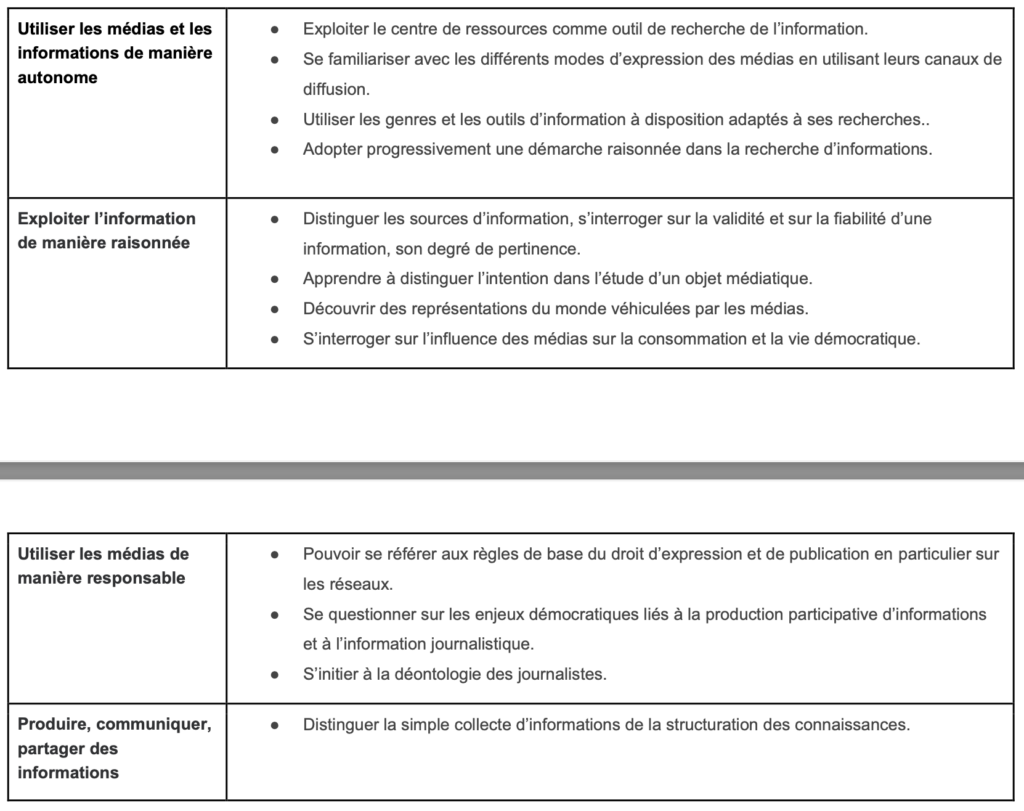

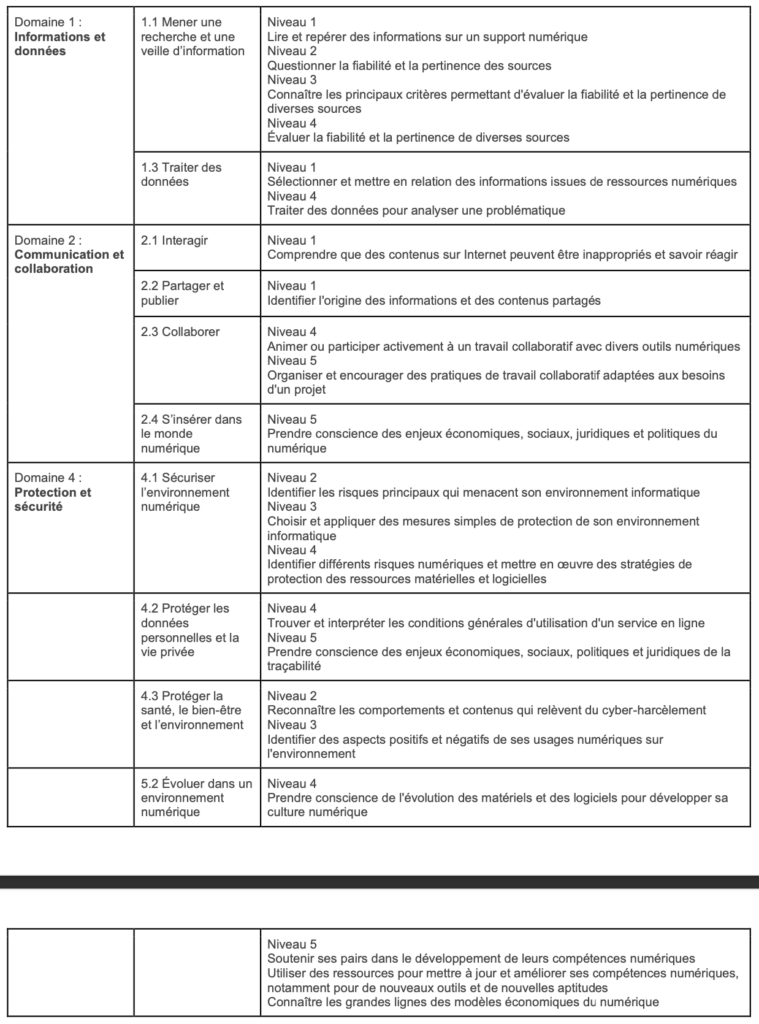

Compétences EMI

Compétences CRCN

Déroulé :

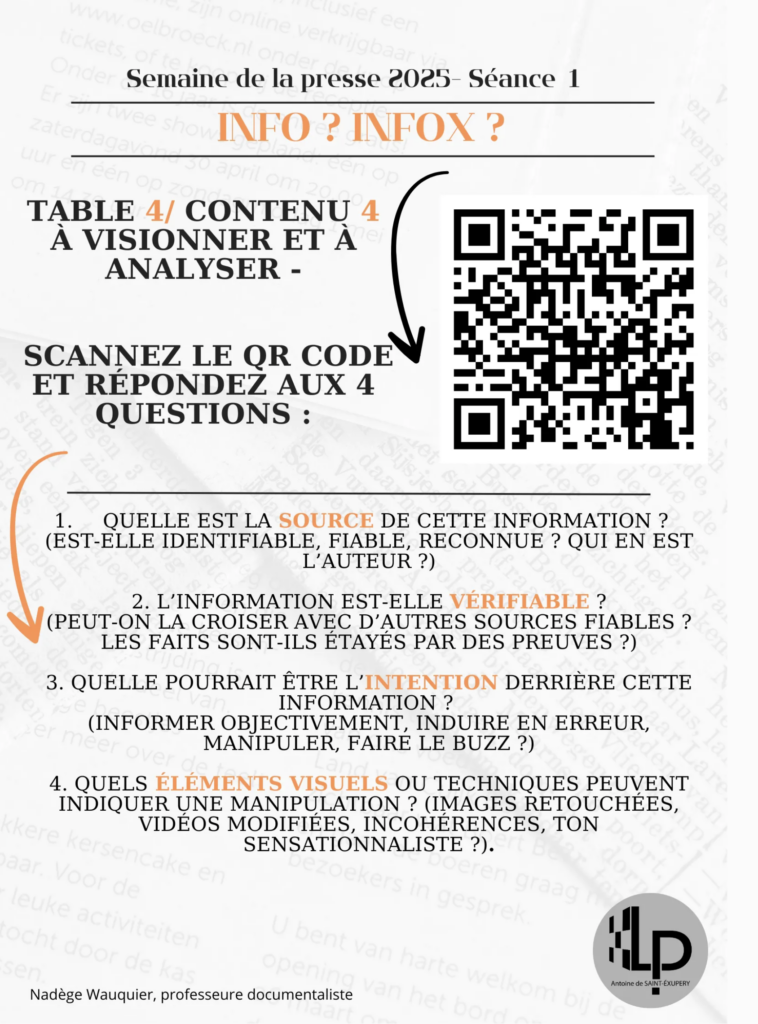

Séance 1 Info ? Mésinfo ? Désinformation ? DeepFake ? Où est l’information ?

1 : Phase d’accroche et diagnostique des pratiques informationnelles des 3PM :

- Sondage élève (10 mn) : « Où vous informez-vous au quotidien ? » Notez au tableau les différentes réponses (réseaux sociaux, applications, sites d’information, télévision, etc.).

2 : Phase d’investigation (25 mn)

Chaque groupe questionne les 4 contenus des 4 tables grâce aux 4 questions pour ensuite présenter à l’oral ses découvertes.

• Quelle est la source de cette information ? Est-elle identifiable, fiable, reconnue ? Qui en est l’auteur ?

• L’information est-elle vérifiable ? Peut-on la croiser avec d’autres sources fiables ? Les faits sont-ils étayés par des preuves ?

• Quelle pourrait être l’intention derrière cette information ? Informer objectivement, induire en erreur, manipuler, faire le buzz ?

• Quels éléments visuels ou techniques peuvent indiquer une manipulation ? Images retouchées, vidéos modifiées, incohérences, ton sensationnaliste ?

Après chaque présentation, ils doivent guider la classe vers l’élaboration collective d’une définition claire de chaque notion et construire ensemble au tableau un schéma distinguant les 4 concepts.

• Information : contenu factuel vérifié, dont la source est identifiée et fiable ;

• Mésinformation : informations fausses qui ne sont pas créées dans l’intention de nuire ;

• Désinformation : informations mensongères, faussées sciemment avec l’intention de tromper ;

• Deepfake : contenu multimédia manipulé ou entièrement créé par intelligence artificielle, pouvant être très réaliste

Séance 2 : L’IA peut-elle être au service de l’information ?

Cette seconde séance approfondit les notions vues précédemment en se concentrant sur l’IA et les deepfakes. Elle montre les usages vertueux et/ou malhonnêtes de l’outil pour éveiller à une nécessaire incrédulité et au questionnement des narratifs rencontrés. Elle questionne l’intention du concepteur et veut démontrer qu’en cette troisième Révolution Digitale, ce sont encore les usages qui font les outils et pas l’inverse. Cette séance participe de la formation à la citoyenneté numérique.

1 : Rappel des définitions élaborées lors de la séance précédente. Introduction du questionnement : « L’intelligence artificielle peut-elle être au service de l’information ? »

2 : Dans 4 ateliers tournants, 4 groupes d’élèves équipés d’un smartphone regardent 4 vidéos illustrant une intention dans l’usage de l’IA dans la fabrique de l’information. Ils questionnent les contenus en répondant à 4 questions :

- Qu’est-ce qui est montré dans cette vidéo ?

- Quelle technologie d’IA est utilisée ?

- Quelle est l’intention des concepteurs de la publication ?

- Cette intention sert-elle l’information ou la désinformation ?

3 : Debrief collectif. Chaque groupe présente une vidéo et ses réponses pour déterminer les intentions de leur concepteur.

L’enseignant propose la réponse d’une IA sur la question. Que dit Anne Kerdi, IA influenceuse, qui publie chaque jour sur les réseaux des posts de promotion de la Bretagne et de la culture bretonne ?

Bilan réflexif :

Deux heures qui permettent aux élèves de rappeler qu’en ces temps d’hyperproduction de narratifs de tout genre, questionner l’intention de l’information demeure crucial pour être bien informé. Harold Lasswell est plus que jamais d’actualité : qui parle à qui par quel canal pour quel effet ? – La troisième révolution digitale avec l’émergence de nouveaux outils de production de contenus présente autant de potentiels que de limites. L’urgence pédagogique reste de dispenser une formation qui force les usages en conscience.

Note des webmestres :

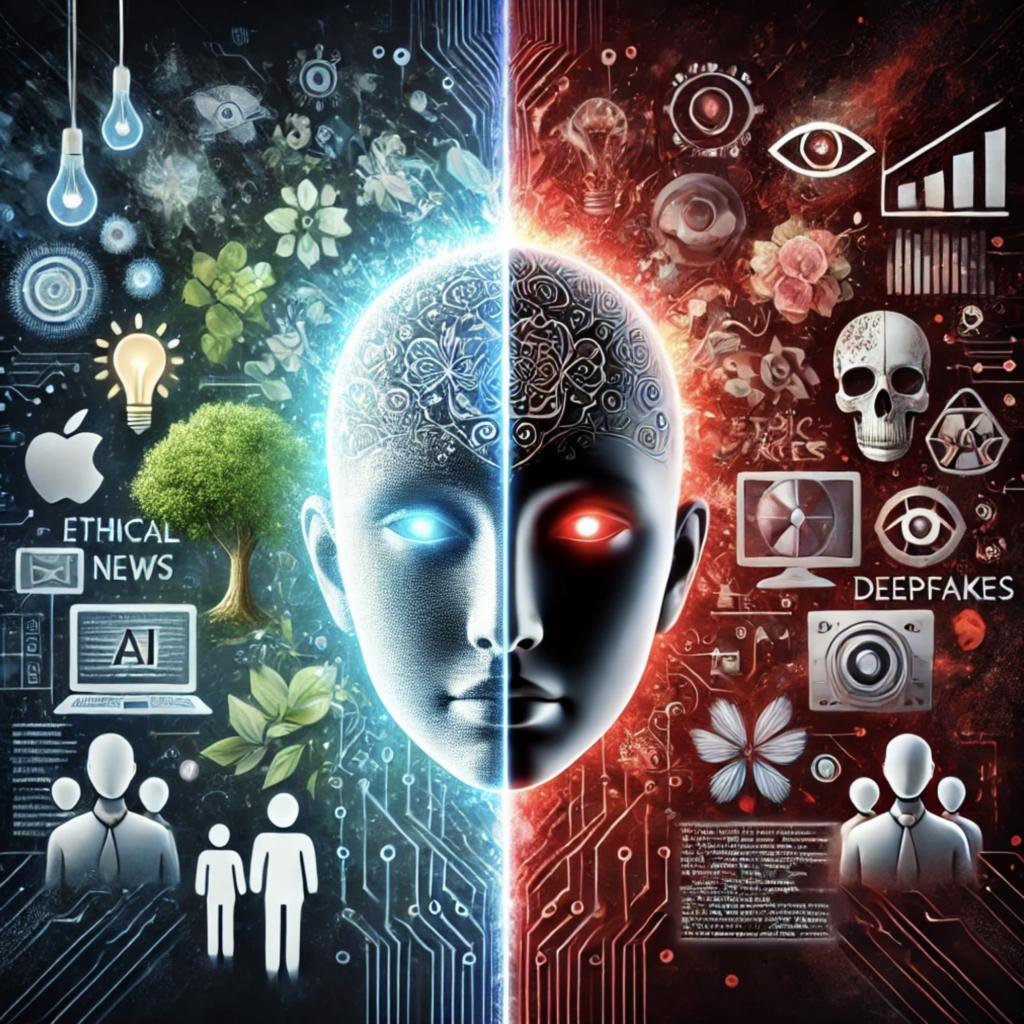

Pour illustrer cet article, nous avons formulé un prompt destiné à ChatGPT et Mistral AI : « Génère une image représentant une IA double : vertueuse d’un côté et destructrice de l’autre. L’IA doit être représentée comme une machine ou un algorithme. » Il s’avère cependant difficile pour ces outils de produire une image qui ne représente pas l’IA sous forme humaine ou humanoïde, contribuant ainsi à l’anthropomorphisation de ces technologies.