Mélanie Serret, professeure documentaliste au lycée polyvalent Giraux Sannier, a cherché à adapter la séquence “photographie numérique” aux avancées des IAG.

Cette séance s’inscrit dans les TRAAM EMI en abordant plusieurs axes :

- l’axe 2, en développant l’évaluation critique des outils d’IA à travers l’analyse des incohérences dans les images générées ;

- l’axe 4, en approfondissant la compréhension technique des IA grâce à un travail sur l’importance de la base de données et du prompt ;

- et l’axe 5, en explorant les nouvelles formes artistiques intégrant l’IA, tout en soulignant le rôle essentiel du guidage humain dans le processus créatif.

Contexte :

L’enseignement de la SNT est, au lycée Giraux Sannier, divisé entre les professeurs de mathématiques et NSI et les professeures documentalistes qui se concentrent davantage sur la partie du programme “impacts sur les pratiques humaines”. Aussi, durant cette séquence, les élèves :

- créent une vidéo sur l’histoire de la photographie à partir d’un hexagon game,

- abordent les notions de droits de/à l’image,

- découvrent des exemples de manipulation d’images et s’interrogent sur les objectifs,

- apprennent à retrouver la source d’une image pour vérifier son contexte de publication,

- font des recherches informationnelles et enregistrent un podcast sur différents sujets en lien avec la thématique.

Il s’agissait d’ajouter une dernière étape à cette séquence pour aborder les images générées par IA.

Public : classes de 2nde GT en ½ groupes.

Objectif :

Aborder le fonctionnement des IA (de reconnaissance puis génératives) et leurs limites actuelles afin de s’interroger sur le rôle de cet outil et celui de l’humain.

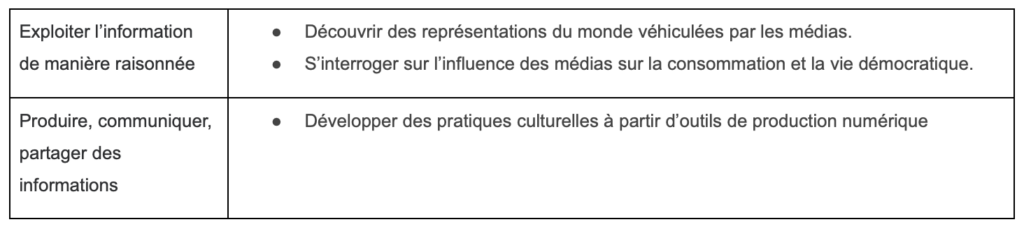

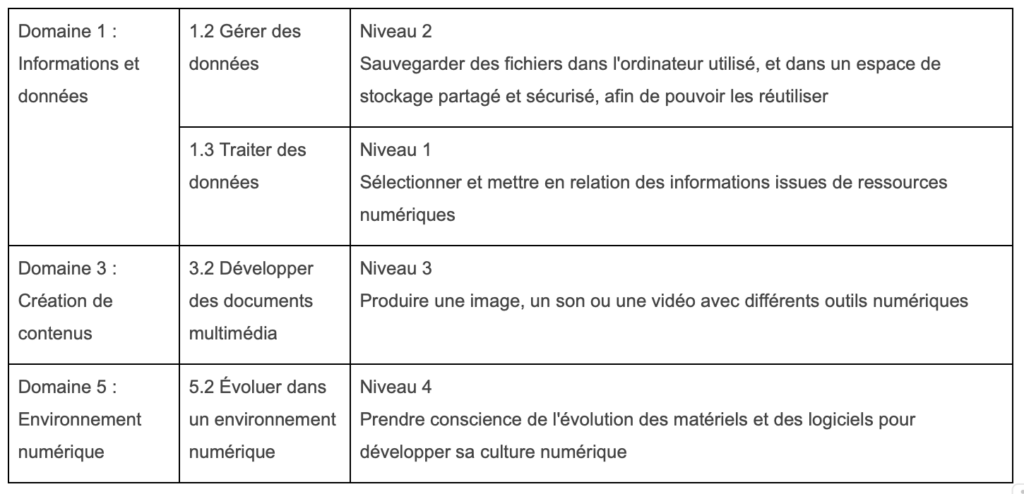

Compétences :

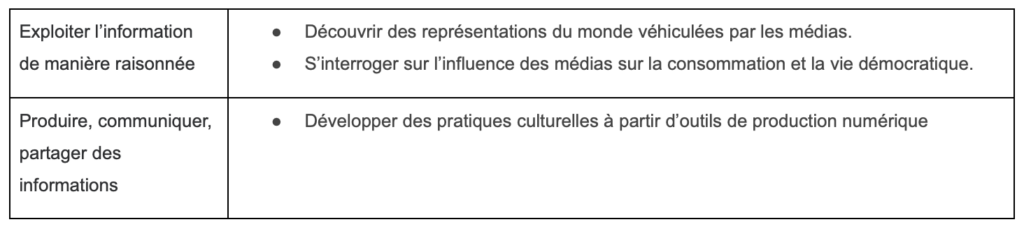

Compétences EMI

Compétences CRCN

CPS

Déroulé :

Partie 1 : l’importance de la base de données.

Les élèves, à partir d’un outil Vittascience, créent une base de données avec deux catégories (chiens et chats) et ajoutent des images choisies (volontairement non représentatives) et partagées par l’enseignante. Vous pouvez visualiser cette étape rapidement à partir de cette vidéo. Cette étape a pour but de démystifier le fonctionnement des IA et d’accompagner les élèves dans un début d’ouverture de la “boite noire”.

La question A a permis aux élèves d’expliquer que l’IA ne “comprend” pas, elle compare des pixels (motifs, couleurs) entre l’image testée et celles de la base de données… Comme lorsque le burger est associé à la catégorie “chiens”. Pour obtenir de meilleurs résultats, il serait nécessaire d’ajouter davantage d’images, en veillant à une représentativité exhaustive et à une diversité de catégories. La gestion de la sélection, de l’exhaustivité et du stockage pose des défis importants.

Partie 2 : l’importance du prompt.

Au début du clip “ça va beaucoup trop vite” de Biglo et Oli, on nous annonce qu’aucun humain n’a travaillé sur ce clip. Les paroles auraient été proposées à une IAG et que l’outil a sorti ce clip. Le but est d’amener les élèves à s’interroger sur cette faisabilité qu’une IA “crée” ou génère quelque chose en autonomie totale. Cette idée d’une IA émancipée de tutelle humaine est souvent relayée, alimentant l’inquiétude d’un remplacement de l’humain par la machine.

Pour explorer cette question, un test a été mené en générant une image sur DALL-E (via ChatGPT en version payante) à partir d’une parole de chanson. Les élèves ont rapidement relevé des incohérences, telles qu’un bureau situé en extérieur ou des enfants en train de travailler, rendant l’image peu crédible dans le cadre d’un clip de rap. Beaucoup ont émis l’hypothèse que l’IA générative avait interprété de manière erronée le pronom « ils » : au lieu de l’associer aux parents, elle l’a attribué aux enfants, probablement en raison de la proximité du terme dans la phrase.

Les élèves découvrent ensuite l’article de Numérama qui les invite à réfléchir sur “fait par IA” et “fait avec IA”. Ils doivent ensuite rédiger un prompt pour générer une image plus pertinente pour cette même parole.

Annexes :

Bilan réflexif :

Outre le clip de Biglo et Oli, il y a aussi le film “La vie quand t’ai mort” de Raphaël Frydman, primé à l’Artefact AI Film. Des médias ont mis en avant un court métrage “généré par IA” alors que d’autres ont salué “l’intelligence, l’humour et la distance (…) qui sort d’un cerveau humain” (cf cet article de France Inter ou encore ici).

La majorité des élèves ont déjà utilisé une IAG sans connaître ni le terme ni l’existence d’une base de données. Ils ont fait la différence entre l’apprentissage humain et l’apprentissage de la machine, ce qui a permis de relativiser le terme “intelligence”. Des élèves ont fait la remarque qu’un enfant reconnaissait un chat après en avoir vu un ou deux, il n’y avait pas besoin d’en voir des milliers sous tous les angles. Ils étaient nombreux à souligner qu’une IAG devait être guidée par des intentions humaines et donc un prompt précis.